IA local para reuniones: Hedy 3.2 ahora puede ejecutarse íntegramente en su dispositivo

Hedy 3.2 le permite ejecutar todo el flujo de procesamiento de IA en su propio dispositivo. Resúmenes, notas, respuestas de chat y sugerencias en vivo ocurren localmente: nada llega a un servidor.

Con Hedy 3.2, todo nuestro flujo de procesamiento de IA ahora puede ejecutarse en su propia máquina. Cuando lo activa, las transcripciones de reuniones, los resúmenes, las notas detalladas, las respuestas de chat y las sugerencias en vivo ocurren en el dispositivo que capturó el audio. Nada sobre sus conversaciones va a un servidor. Esto es lo que cambia cuando la IA de sus reuniones funciona de esa manera.

El reconocimiento de voz se ejecuta en su dispositivo desde el día en que lanzamos Hedy. Las grabaciones de audio también siempre han permanecido en el dispositivo. Sus conversaciones nunca se han usado para entrenar modelos de IA. Hemos sido deliberados con la privacidad desde el principio.

Pero siempre hubo una pieza que no podíamos llevar al dispositivo: el trabajo de IA en sí. La parte que lee su transcripción, escribe su resumen, toma sus notas detalladas, responde a sus preguntas sobre una reunión y ofrece sugerencias mientras está en ella. Ese trabajo tenía que ocurrir en servidores, porque los modelos capaces de hacerlo bien eran demasiado grandes para ejecutarse en un portátil o un teléfono.

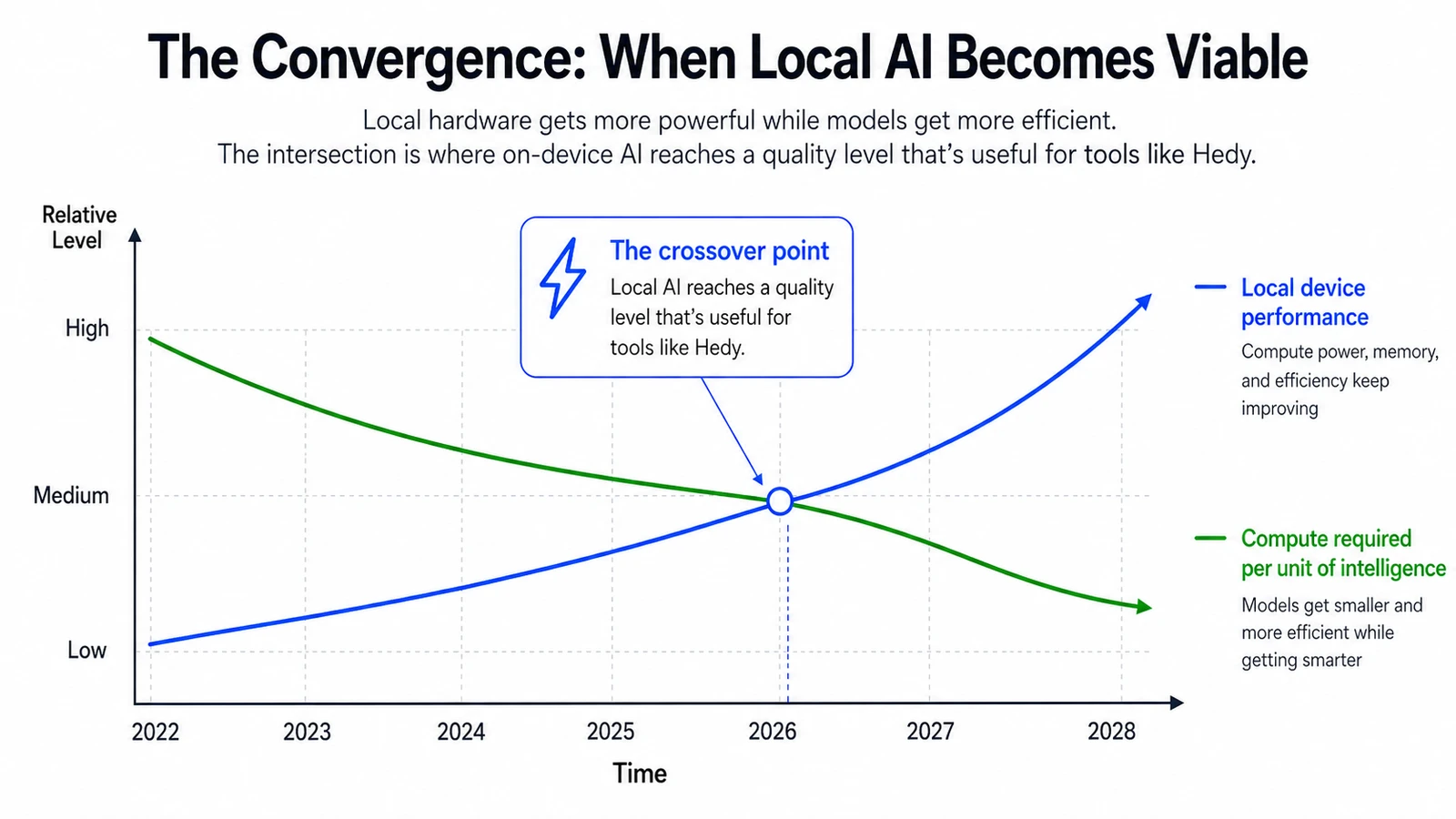

Eso ha estado cambiando rápidamente. Los dispositivos siguen volviéndose más potentes. Los propios modelos de IA siguen haciéndose más pequeños y más inteligentes al mismo tiempo. Hace unos meses, esas dos tendencias se cruzaron para nosotros. Los modelos que caben en un portátil o en un iPhone reciente ahora son lo bastante sólidos como para gestionar el análisis de Hedy con un nivel de calidad útil para reuniones reales.

Ilustrativo: las curvas muestran la dirección general, no mediciones específicas.

Así que, con Hedy 3.2, puede activar Local AI Processing y ejecutar todo nuestro flujo de procesamiento de IA en su propio dispositivo. Resúmenes, notas, respuestas de chat, sugerencias. Todo ocurre en su máquina.

Por qué importa la IA en el dispositivo

Durante la mayor parte de los últimos años, la IA ha sido algo que unas pocas grandes empresas operan en su nombre. Usted envía sus datos a sus servidores, sus modelos los procesan y los resultados vuelven. Ese modelo tiene ventajas obvias y ha impulsado la mayor parte de lo que hemos podido construir. También tiene un coste estructural: la IA más útil requiere los datos más personales, y esos datos viven en un lugar distinto de donde se generaron.

La IA local invierte esa lógica. Su conversación permanece donde ocurrió. El trabajo se realiza en el mismo dispositivo que capturó el audio. Nada sobre la reunión llega a un servidor a menos que usted decida activar Cloud Sync, e incluso entonces el procesamiento de IA permanece local.

Si mantiene Cloud Sync desactivado, su conversación existe solo en el dispositivo que la grabó. De principio a fin.

Quién se beneficia de una IA de reuniones privada y en el dispositivo

Algunos usuarios de Hedy activarán esto y no volverán a pensarlo. Otros llevan años esperando algo así. Estos son quienes creemos que más se benefician.

- Coaches y consultores cuyas conversaciones con clientes tienen expectativas estrictas de confidencialidad. Han usado Hedy para preparación y llamadas internas. Ahora pueden usarlo durante el trabajo con clientes sin que nada salga del portátil.

- Abogados que usan Hedy para llamadas internas, pero nunca para conversaciones con clientes. El privilegio abogado-cliente tiene una forma específica, y “prometemos manejar sus datos con cuidado” no encaja en esa forma. Los datos que no se mueven sí encajan.

- Pacientes que van a citas médicas y quieren un resumen claro de lo que dijo su médico, pero no quieren que su conversación de salud quede en un servidor de terceros. Con Local AI Processing, el resumen puede ocurrir en el mismo teléfono que grabó la conversación.

- Periodistas que trabajan en historias sensibles y evitan por completo las herramientas en la nube. Pueden grabar una entrevista, obtener una transcripción y chatear con la reunión, todo sin que nada llegue a un servidor.

- Cualquiera fuera de EE. UU. que no quiera que sus conversaciones residan en servidores estadounidenses. Añadimos residencia de datos en la UE en la versión 2.15. La IA local lleva eso un paso más allá: los datos no residen en los servidores de ninguna empresa.

- Trabajadores remotos con wifi malo en aviones o en zonas rurales sin cobertura. Hedy ahora funciona completamente sin conexión. Abra el portátil en un vuelo, tenga una conversación real y obtenga el resumen antes de aterrizar.

- Curiosos por la privacidad que no tienen una profesión regulada ni un modelo de amenaza específico. Simplemente preferían la idea de que aquello que escucha sus reuniones no enviara el audio a ningún sitio. Antes no podían tener eso. Ahora sí.

Lo que une a estas personas es que Hedy ya era útil para ellas en concepto, pero el modelo de datos no encajaba con sus restricciones. Local AI Processing elimina esa restricción.

La versión honesta

Queremos ser claros sobre lo que esto es y no es, porque preferimos que entre con expectativas realistas antes que se sienta decepcionado más adelante.

Local AI Processing es opcional y está desactivado por defecto. Cloud AI sigue siendo más rápido, sigue produciendo mejores resultados y funciona en todas las plataformas compatibles con Hedy. Si no tiene una razón específica para querer procesamiento en el dispositivo, la opción en la nube es la mejor experiencia por ahora.

Un resumen que parece instantáneo en la nube puede tardar entre 30 segundos y varios minutos localmente, dependiendo de su hardware y del modelo que elija. Los modelos más pequeños son buenos para resúmenes cortos, pero pueden tener dificultades con conversaciones largas o matizadas. Los modelos más grandes se acercan a la calidad de la nube, pero necesitan hardware real para ejecutarse bien. Y no recurrimos silenciosamente a la nube cuando algo falla localmente. Usted eligió lo local por una razón, y un reintento silencioso contra nuestros servidores traicionaría esa intención. Verá un error en su lugar.

La IA local es compatible con Macs con Apple Silicon, máquinas Windows con GPUs capaces, iPhones recientes (15 Pro y posteriores) e iPads M-series. Android y Web están en nuestra hoja de ruta, pero aún no están listos. La variación en el hardware Android y las restricciones de ejecutar modelos dentro de un navegador hacen que hoy sea difícil ofrecer una experiencia consistente.

Usted elige el modelo que se ajusta a su hardware. Ofrecemos tres niveles de calidad, desde modelos compactos que caben en un teléfono, pasando por opciones de nivel intermedio que funcionan bien en la mayoría de portátiles modernos, hasta modelos más grandes que se acercan a la calidad de la nube en hardware capaz. El selector de modelos le muestra qué encaja antes de descargar.

Hacia dónde va esto

La IA local en Hedy 3.2 es un punto de partida, no un producto terminado. Los modelos seguirán mejorando. El hardware de consumo seguirá ganando capacidad. La brecha entre la calidad local y la de la nube seguirá cerrándose. Ampliaremos el soporte a más plataformas a medida que la tecnología lo permita.

Esto forma parte de un cambio más amplio que merece reconocimiento. Durante años, los mayores avances en IA han venido de empresas ejecutando modelos cada vez más grandes en granjas de servidores cada vez mayores. En paralelo está ocurriendo un cambio más silencioso: los modelos de pesos abiertos se vuelven más inteligentes y más pequeños cada pocos meses. El hardware para ejecutarlos está en los bolsillos y en los escritorios de la mayoría de las personas. La brecha de capacidad entre la IA de reuniones en la nube y la IA de reuniones en el dispositivo se está cerrando rápidamente.

La visión general importa más que cualquier lanzamiento concreto. Creemos que los próximos años de la IA estarán definidos por un cambio: de un mundo en el que unas pocas empresas operan la IA en su nombre, a uno en el que usted puede ejecutar su propio flujo de procesamiento, en su propio dispositivo, con sus propios datos, de principio a fin. Que elija hacerlo o no, tener la opción es lo que da a la tecnología su forma adecuada. Mantiene el poder equilibrado.

Hedy está construido para estar al frente de ese cambio. La IA local es el primer paso concreto. Habrá más.

Para activarlo, actualice a Hedy 3.2 y busque en Settings, dentro de Speech & AI. El interruptor se llama Local AI Processing. Elija un modelo que se ajuste a su hardware y estará listo.

Si lo prueba, nos encantaría saber qué piensa.